Ergens in het landschap van de Zwarte Zwaan, de Grijze Neushoorn en de Zwarte Eend bevindt zich ook de Predictable Surprise. Na het lezen van Max Bazerman’s boek ben ik geneigd de voorspelbare verrassing een olifant in de kamer te noemen. Een glazen olifant om precies te zijn. Eentje waar je dwars door heen kunt kijken, maar die als je hem verkeerd raakt met donderend geraas versplintert.

Ik had stiekem een beetje gehoopt dat Bazerman in zijn boek alles zou onthullen over de geheime kunst van het voorspellen van verrassingen tijdens crises. Dat je ergens aan je Dikke BOB een checklistje kan toevoegen waardoor je nooit meer verrast zal worden. Naar zo’n soort uitgave zal ik nog verder moeten zoeken, weet ik nu.

Toch schreef Bazerman met zijn maatje Michael Watkins een herkenbaar boek. Beiden waren indertijd hoogleraar, Bazerman op Harvard en Watkins in Lausanne. Ook al is het 15 jaar oud, het boek is nog steeds zeer actueel. Logisch, met zo’n tijdloos onderwerp als het menselijk onvermogen om rationele besluiten te nemen in grijs gebied en vage omstandigheden. Daar kan je nooit genoeg over leren.

Predictable is in dit kader dan ook echt voorspelbaar: als je situation awareness op orde is en je ruggengraat recht wordt je niet zo snel verrast, zo is de algemene strekking. Frequente lezers van Rizoomes wisten dat natuurlijk al wel.

Maar er is meer over te vertellen.

Predictable surprise

Laten we beginnen om die voorspelbare verrassing eens wat nader uit te werken. Bazerman onderscheidt zes karakteristieken van een predictable surprise.

- De leiding weet dat er een probleem is dat zich niet vanzelf oplost, maar doen er niets aan. Regeren is immers vooruitschuiven. Bazerman geeft als sprekend voorbeeld dat de Amerikaanse overheid bekend was met het feit dat de aviation security voor 9/11 niet op orde was. Net als het stikstofprobleem in Nederland nu.

- Ondertussen zien ze op de werkvloer wel dat het probleem steeds groter wordt. En omdat het zichzelf niet oplost, wordt de voorspelbaarheid van de verrassing steeds groter. Daar komt ook die beroemde oneliner naar voren: het is niet de vraag of het gebeurt, maar wanneer het gebeurt. Da’s de opmaat naar een voorspelbare verrassing.

- Een derde kenmerk van predictable surprise is dat de kosten om het probleem op te lossen in het heden vallen, in jouw regeerperiode, terwijl de baten in de toekomst geoogst gaan worden tijdens iemand anders’ bewind. Daar hebben veel bestuurders geen zin in.

- Daaraan gerelateerd is dat de kosten om een voorspelbare verrassing te voorkomen vaak wel goed uitgerekend kunnen worden (en heel hoog zijn), maar dat de omvang van de vermeden schade niet goed is in te schatten.

- Het vijfde kenmerk van een predictable surprise is dat besluitvormers falen in hun preparatie omdat ze graag de huidige status quo handhaven. Anders gezegd, als er nog geen duidelijke crisis is, is de tendens om maar niet in te grijpen groot.

- Tot slot is er ook altijd een groepje die wel lekker vaart onder de situatie en er dus baat bij heeft om de eerste vijf kenmerken te versterken en grote veranderingen tegen te houden of zelfs te ondermijnen.

Hindsight Bias

De zes kenmerken zie je terugkomen in de hoofdstukken over 9/11 en Enron, waarin Bazerman uitpluist wat er allemaal al bekend was voor die rampzalige gebeurtenissen zich afspeelden. Dat leidt tot waarnemingen als deze:

People tend to ignore the harm that comes from inaction. When the benefits of actions are vague, such as a long term reduction in air disasters, individuals will be unwilling to accept sure losses, such as security fees and long lines at airports.

bazerman & watkins

Wat Bazerman en Watkins goed doen is het vermijden van hindsight bias. Sterker nog, ze laten goed zien op welk moment welke informatie al bekend was en hoe er expliciet niet ingegrepen is. Daardoor krijgt het met-de-kennis-van-nu-syndroom geen poot aan de grond. Eigenlijk wist men alles, zo blijkt, behalve het precieze tijdstip en de omvang van de aangekondigde ramp. Dat was dan ook de enige verrassing, de rest was voorspelbaar.

Wortels van het kwaad

Na deze rampenanalyse buigen Bazerman en Watkins zich over de cognitieve, organisatorische en politieke wortels van het kwaad. Dat neemt het grootste deel van het boek in beslag, maar is samen te vatten in een paar hoofdlijnen. Lekker handig.

Bazerman onderscheidt vijf soorten irrationaliteit die hij betitelt als de cognitive roots van predictable surprise. Waarschijnlijk zou Kahneman ze als human bias bestempelen

- Mensen schatten hun wereld en de naaste omgeving vaak positiever in dan de rest van de wereld. Daarnaast vindt iedereen zich een betere chauffeur dan het gemiddelde, schat men zich slimmer in dan de meeste anderen in het land (“ben ik nou zo slim of zijn jullie zo dom”) en zien we onszelf als een deskundiger vakmens dan de gemiddelde collega.

- Wat we ook vaak doen: de credits pakken als iets goed ging, en de schuld afschuiven naar een ander. De fout is de ander; ik doe het goed. Mensen redeneren dus egocentrisch, schrijft Bazerman.

- Waar ook Kahneman al op wees is dat mensen de neiging hebben liever voor iets zekers in het nu te gaan, dan voor een mogelijke beloning in de toekomst. Present bias, heet dat. Het mechanisme erachter zorgt er onder andere voor dat goede voornemens voor straks stralen vanwege de verleidingen in het nu.

- We houden graag de bestaande status quo in stand en zijn niet erg geneigd iets te veranderen met te grote gevolgen, al helemaal als ze negatief kunnen uitpakken. Don’t fix what isn’t broken.

- Tot slot willen mensen niet graag iets doen om een probleem te voorkomen dat ze niet zelf herkennen of waar ze zelf geen last van hebben. “Dat gebeurt alleen daar, wij zijn beter, wij weten wel hoe het moet.”

En zo worden ongewenste gebeurtenissen dus langzamerhand steeds meer in de hand gewerkt. Want het is niet dat deze vijf eigenaardigheden zich stuk voor stuk aandienen, het is een setje van vijf dat altijd samen werkt.

Dan wordt het opgeteld ongeveer zo. Mensen zien de toekomst te rooskleurig in, gaan liever voor iets zekers nu dan wat onzekers later, denken dat ze zelf de betere besluiten nemen en dat het heden dus helemaal nog zo slecht niet is en menen dat problemen die elders spelen hier niet zullen gebeuren.

Organisatorische factoren

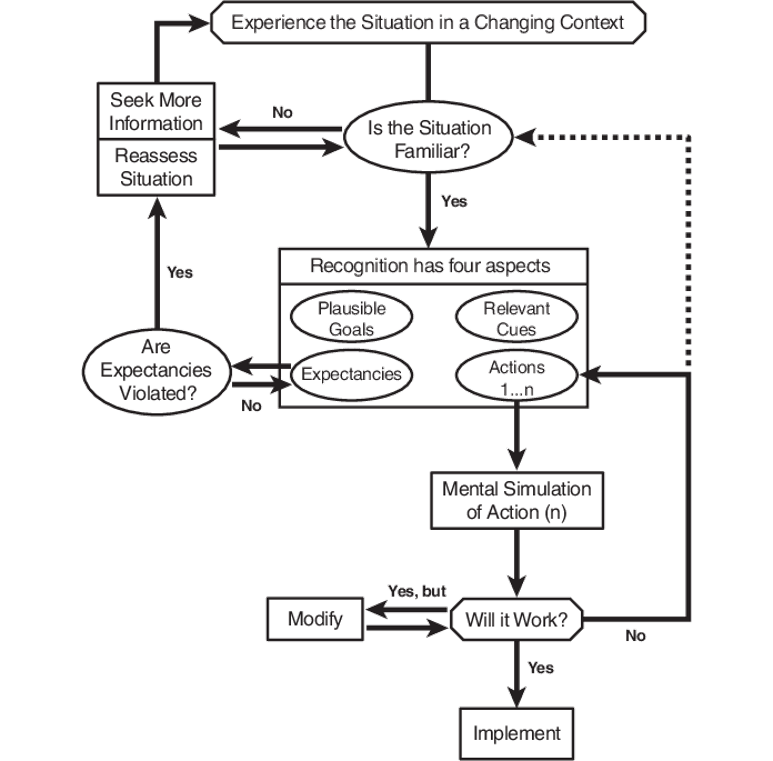

Komen we bij de organisatorische roots. Volgens Bazerman moet een organisatie over vier vaardigheden beschikken om voorspelbare verrassingen zo veel als mogelijk te voorkomen.

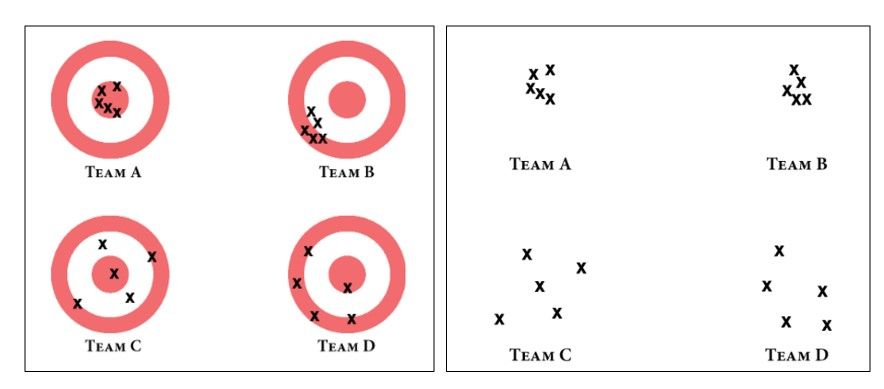

In de eerste plaats moet je continu de omgeving blijven scannen op mogelijke dreigingen. Voorkom dat je de onderstroom mist, denk nooit dat iets niet zal gebeuren en zorg voor een situational awareness niveau drie. Hier huist namelijk ook de fundamental surprise en die moet je zien te voorkomen.

Combineer en analyseer de informatie uit de verschillende bronnen in je organisatie tot een integraal geheel waar je op kan acteren. En doe dat dan ook, zo schrijft de derde vaardigheid voor, waarna je de resultaten van je acties opnieuw analyseert. Weak signals, hard response noemt Weick dat.

Tot slot moet je structureel op dit proces blijven reflecteren, het steeds weer herhalen en de resultaten opslaan in een organisatorisch geheugen. Om te voorkomen dat je de fouten uit het verleden gaat herhalen.

Hoe eenvoudig dit ook klinkt, er gaat onderweg erg veel fout. Om te beginnen door scanning failures, zegt Bazerman. Mensen hebben last van tunnelvisie en missen daardoor een stuk van het plaatje, vaak zonder dat ze het door hebben.

Dat wordt versterkt door ruis, zoals ik onlangs in dit blog schreef, plus een information overload. Er is te veel en de hoofd- en bijzaken worden door elkaar gehaald.

Ook bij de verwerking van de informatie gaat er veel mis in organisaties. Ten eerste als er te veel in silo’s wordt gewerkt. Afdelingen werken dan langs elkaar heen en wisselen nauwelijks data uit. Los daarvan houden mensen ook sommige kennis geheim. Informatie is volgens hen handel en dat geef je niet gratis weg, denkt men dan.

Verder zijn er ook gewoon belangentegenstellingen; waar veel mensen werken zijn veel verschillende belangen. Niet iedereen kan immers promotie maken, ‘maar die hansworst uit die kamer hiernaast al helemaal niet.’ Daar zorgen de collega’s onderling dan wel voor in hun krabbenmandjes. Individuele bonusregelingen werken dit gedrag trouwens in de hand.

Ook niet onbelangrijk: organisaties die voldoen aan de kenmerken van het vulnerable system syndrome hebben nogal eens last van illusionaire consensus, oftewel de gedachte dat iedereen het met elkaar eens is. In werkelijkheid houden mensen op cruciale momenten hun mond omdat ze weten dat ze anders een hoop gezeik krijgen.

Lerende organisatie

De laatste van de vier vaardigheden is leren. Bazerman kijkt naar de lerende organisatie vanuit twee variabelen. Ten eerste op de as van individuele kennis versus groepskennis. En ten tweede van tacit knowledge tot explicit knowledge. Het levert vier vlakken op met een verschillend kennisprofiel, zie hieronder.

Het kwadrant linksboven is het makkelijkste te realiseren en wekt de illusie van control. Daarom zijn veel bedrijven en organisaties daar ook zeer druk mee en gooien hun medewerkers vol met gedragsregels, geboden en verboden. Dat is overigens niet verkeerd, maar het is maar een deel van wat een lerende organisatie nodig heeft.

Helaas gaan veel organisaties niet verder dan het linker bovenkwadrant en roept men bij wat mis ging dat het een menselijke fout was.

Tacit knowledge is veel lastiger te managen. Het is de ervaring die mensen opdoen in de praktijk, de oude bootsman die weet waar te slaan om de boel weer aan de praat te krijgen.

Think of the employees responsible for mainitaining production equipment in a manufacturing plant. They come to know all of the idiosyncrasies of many, seemingly similar systems – a knowledge that is very difficult to codify and transmit.

bazerman & watkins

Het meest lastige vak om te managen is die rechtsonder. Daar zit teamervaring. Mensen die veel samenwerken, weten hoe de anderen zullen handelen in de praktijk, wat ze gaan doen in verschillende omstandigheden. Het zijn ervaringen die moeilijk zijn om te zetten in explicit knowledge en daarom gebeurt het meestal ook niet.

Bij reorganisaties worden teams vaak door elkaar gegooid en verliest men de tacit – relational knowledge, wat pas later in de praktijk duidelijk wordt als de performance opeens schrikbarend daalt. Het is een predictable surprise op zich. Hetzelfde zie je gebeuren als ervaren mensen en masse een bedrijf verlaten en er grote gaten vallen in de opgebouwde expertise; dan ben je een bedrijf met geheugenverlies, een vergetende organisatie.

En het interessante van vergeten is dat het in principe oneindig is. Het houdt niet op, niet vanzelf.

Glazen Olifant

De derde categorie wortels van het kwaad is de politiek. Bazerman schrijft een hoofdstuk vol over het Amerikaanse politiek systeem en hoe dat bijdraagt aan predictable surprise door voornamelijk de status quo van het land in stand te houden en grote veranderingen tegen te houden. Zijn bevindingen zijn niet zonder meer op ons land over te zetten, maar zijn niettemin wel interessant en ook herkenbaar.

Het twee partijen systeem maakt de Amerikaanse politiek kwetsbaar voor belangengroeperingen, lobby’s en beïnvloeding vanuit industrie en heersende macht. Wie aan de macht wil komen, moet veel geld hebben of regelen en tracht daarna die macht ook te houden. Dat proces voorkomt noodzakelijke veranderingen en vergroot de kans op een voorspelbare verrassing.

A core problem is that the decisionmakers who must act to prevent the surprise are benefitted, at least in the short term, by the failure to expense stock options. Preventing predictable surprise requires changing traditional approaches to problems, and change inevitably creates winners and losers. Yet when the gains far exceed the losses, change should occur. The challenge to leaders is to block the destructive political behavior of those who will be negatively affected by change – even if these people are the leaders themselves.

bazerman & watkins

Dat is nog eens een glazen olifant in de kamer. Bazerman zette hem er in 2008 in. Toen ik laatst keek stond hij er nog steeds, op precies dezelfde plaats.

Ongoing predictable surprise, zo noemt Bazerman dat. Als voorbeeld geeft hij het systeem van landbouwsubsidies en visserij in Europa, die altijd zijn verantwoord om traditionele systemen in stand te houden en te voorkomen dat het platteland leegstroomt. Daar is niks op tegen, schrijft hij, maar inmiddels krijgen boeren veel geld om een hoeveelheid voedsel te produceren die groter is dan wat de wereld nodig heeft. Dat zulks tot milieuproblemen zal leiden noemt hij een predictable surprise.

Vijftien jaar geleden dus al.

Black Swan

Andere voor hem toekomstige predictable surprises zijn global warming, de kosten van vergrijzing en exploderende frequent flyer programs. Ook die komen niet onbekend voor. Hetgeen niet betekent dat daarmee het probleem is opgelost, laat Bazerman met zijn boek zien. Tussen droom en daad staan praktische bezwaren en diep ingesleten gedragspatronen. Problemen veranderen wel, maar de menselijke aard niet. Dat maakt uiteindelijk elke verrassing voorspelbaar, lijkt het.

Wat Bazerman en Watkins laten zien is hoe een systeem steeds fragieler wordt door die cognitieve, organisatorische en politieke factoren. Men schuift alles voor zich uit, waardoor noodzakelijke aanpassingen en veranderingen uitblijven. Langzamerhand gaat alles schuren en wringen en verdwijnen één voor één de opties om een crash van de glazen olifant te voorkomen.

Op enig moment zal er hoe dan ook schade zijn, wat je ook doet. Zelfs als je niets doet. Dat is zugzwang, schreef ik hier. De crises en rampen die daar uit voortkomen zijn in die zin dus voorspelbaar. Niet de precieze omvang en tijdstip van zo’n voorval; wel dat de boel zo wankel staat dat er een keer iets mis zal gaan.

De vraag is nu of het ook Black Swans zijn, die predictable surprises. Black Swans kun je immers slechts achteraf voorspellen, zegt Taleb, terwijl Bazerman nu claimt ze vooraf te kunnen voorzien. Als je maar goed om je heen kijkt.

Tegelijkertijd schreef Zvi Lanir over de fundamental surprise. Dat crises ontstaan door een te groot ego en een fout wereldbeeld. Daaruit concludeerde ik dat elke fundamental surprise wel een Black Swan is, maar niet elke Black Swan een fundamental surprise. Overigens kwam Taleb later wel iets terug van zijn rigide opvatting over de onvoorspelbaarheid van de Black Swan.

‘Don’t be the Turkey’, zei hij daarover, waarmee hij bedoelde dat in ieder geval je situation awareness op niveau moet zijn om een Black Swan te voorkomen.

De vraag die nu nog rest is of er ook echt onvoorspelbare verrassingen zijn? Hoe ziet een unknown unknown eruit voor hij zich onthult? En als je hem kunt zien, is het dan geen known unknown?

We zoeken door.